"Eu acho que esses sistemas podem ser muito destrutivos", afirma o professor da NYU Gary Marcus

"Algo inacredit�vel est� acontecendo na intelig�ncia artificial neste momento — e n�o � inteiramente para o bem", escreveu seis meses atr�s Gary Marcus, professor em�rito da Universidade de Nova York (NYU), nos Estados Unidos, e uma das principais vozes no debate sobre a IA na atualidade.

Em sua vis�o, o lan�amento do ChatGPT nos est� levando ao "momento Jurassic Park" das m�quinas: a possibilidade — como no filme de Steven Spielberg — de que a situa��o fuja do controle.

"Quando escrevi esse artigo, acho que as pessoas pensaram que eu era louco ou alarmista", afirmou Marcus, em entrevista � BBC News Brasil.

A esposa sustenta que o contato com o programa o levou a tirar a pr�pria vida. Para o governo belga, o caso � "um precedente que deve ser levado a s�rio" e "o perigo do uso [de intelig�ncia artificial] � uma realidade que precisa ser considerada".

Foi um cen�rio poss�vel descrito quatro meses antes por Marcus em artigo para a revista Wired: "Talvez um chatbot v� magoar algu�m t�o profundamente que a pessoa ser� levada a acabar com a sua vida? (...) Em 2023, n�s talvez vejamos nossa primeira morte por um chatbot".

"Acho que esses sistemas podem ser muito destrutivos. E parte do motivo do potencial de destrui��o � que eles n�o s�o confi�veis. Esses programas podem inventar algo e dizer [a um usu�rio] que isso � um fato. E eles tamb�m podem ser usados por pessoas com essa finalidade", diz.

"Os sistemas de intelig�ncia artificial que temos agora n�o s�o bem controlados. Ainda n�o � uma situa��o terr�vel, mas as pessoas est�o dando mais e mais poderes a eles. E n�o sabemos o que esses sistemas podem executar em uma determinada situa��o".

'Sete previs�es sombrias'

Marcus compilou no ano passado "sete previs�es sombrias" sobre sistemas como o ChatGPT, entre elas a de que a vers�o mais nova do programa seria como um "touro em uma loja de porcelanas, imprudente e dif�cil de controlar. Far� um significativo n�mero de erros est�pidos, de fazer balan�ar a cabe�a, em maneiras dif�ceis de prever".

No final de mar�o, um caso bizarro chamou a aten��o. Uma pessoa pediu ao ChatGPT para citar acad�micos envolvidos em epis�dios de ass�dio sexual.

A lista mencionava um professor norte-americano de Direito, Jonathan Turley. O programa disse que Turley fez coment�rios sexualmente sugestivos a uma aluna durante uma viagem ao Alasca e tentou toc�-la. A resposta citava como evid�ncia uma reportagem de 2018 do jornal The Washington Post.

Mas nada disso jamais existiu: nem a viagem, nem a reportagem ou mesmo a acusa��o. S� o professor e sua reputa��o eram de verdade. � como se o rob� tivesse inventado uma cal�nia.

A OpenAI, empresa do ChatGPT, divulgou um comunicado dizendo que o programa "nem sempre gera respostas precisas".

Para Marcus, "n�o temos nenhuma garantia formal de que esses programas v�o trabalhar da forma correta, mesmo quando fazem c�lculos matem�ticos. �s vezes eles est�o corretos, �s vezes n�o. Falta de controle e de confiabilidade s�o problemas que enxergo".

"A sua calculadora tradicional tem a garantia de uma resposta aritm�tica. Mas os grandes modelos de linguagem, n�o".

Ele se refere ao sistema por tr�s do ChatGPT, os LLMs (sigla em ingl�s para large language models), que armazenam quantidades gigantescas de dados e geram, por meio de poderosos algoritmos, respostas por aproxima��o baseadas no que j� foi dito antes por humanos.

Em resumo: um papagaio ultrassofisticado, mas que n�o faz ideia do que est� falando e �s vezes "alucina" — um termo da IA que designa uma resposta fora do esperado, desalinhada da expectativa dos programadores.

"Os LLMs n�o s�o t�o inteligentes assim, mas s�o perigosos", diz Marcus, que tamb�m colocou o crescimento de momentos de alucina��o dentro de sua lista de "previs�es sombrias".

O ChatGPT ultrapassou 100 milh�es de usu�rios ap�s seu lan�amento

Getty ImagesAl�m dos geradores de texto, os programas que manipulam imagens tamb�m evoluem rapidamente.

Recentemente uma foto do papa Francisco com uma descolada jaqueta prata, feita com o programa Midjourney, deixou a internet confusa por algumas horas: aquela imagem era real?

O epis�dio teve consequ�ncias inofensivas, mas foi uma amostra do potencial para inaugurar uma zona cinzenta permanente entre fatos e falsifica��es.

"A n�o ser que a gente tome provid�ncias, estamos pr�ximos de entrar em um ambiente de p�s-verdade", afirma o professor da NYU.

"O que torna tudo muito dif�cil para a democracia. Precisamos de san��es para quem produz desinforma��o em massa, exigir marcas d'�gua para identificar de onde vem a informa��o e criar novas tecnologias para detectar inverdades. Assim como existe programa de antiv�rus, precisamos de software antidesinforma��o".

'O capitalismo n�o vai resolver esses problemas'

A experi�ncia de Marcus, de 53 anos, n�o � restrita ao mundo acad�mico. Ele vendeu uma empresa para o Uber e se tornou diretor de um laborat�rio de IA da gigante dos apps de transporte — deixou o cargo depois de apenas quatro meses, num per�odo em que a companhia enfrentava acusa��es de manter um ambiente "t�xico".

Questionado se o famoso mantra "mova-se r�pido e quebre coisas" do Vale do Sil�cio e a competi��o desenfreada por mercados justamente n�o cria circunst�ncias perigosas para o desenvolvimento da intelig�ncia artificial, ele diz que "n�o d� para esperar que o capitalismo, por si s�, v� resolver esses problemas".

Ele defende que as empresas sejam objeto de regulamenta��o e cita o mercado de avia��o como um exemplo de que � algo necess�rio.

"O setor a�reo na d�cada de 1950 era um desastre. Os avi�es ca�am o tempo todo. A regulamenta��o foi boa para o setor a�reo, conseguiu que a ind�stria a�rea desenvolvesse um produto melhor no final das contas", afirma.

"Deixar as coisas nas m�os das empresas n�o necessariamente leva ao caminho correto. Voc� quer que as empresas sejam parceiras para construir o que precisa ser feito. Mas h� uma raz�o para ter governos, certo?".

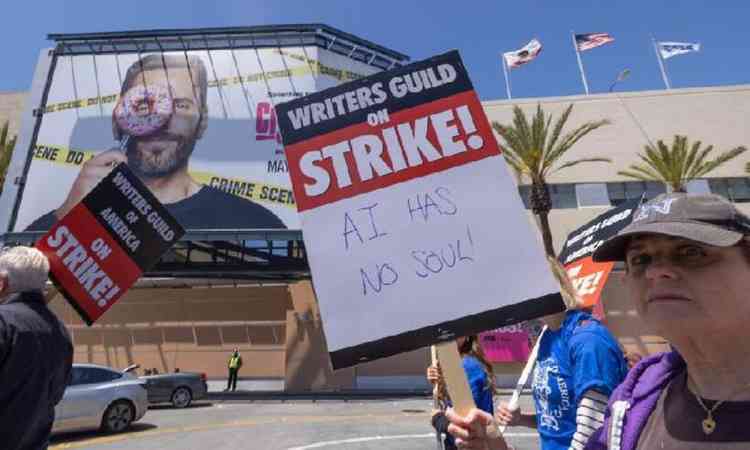

Cartaz na greve dos roteiristas de Hollywood diz: "A intelig�ncia artificial n�o tem alma"

Getty ImagesEntendimento com o 'padrinho da IA'

O posicionamento de cautela e desconfian�a com o entusiasmo pela r�pida evolu��o da IA nem sempre foi bem recebido.

O ceticismo de Marcus foi ironizado em outros anos por seus pares (principalmente em alfinetadas pelo Twitter), mas a mar� mudou: diversas personalidades da �rea come�aram a adotar um tom diferente.

Geoffrey Hinton, chamado de "padrinho da IA", anunciou seu desligamento do Google e afirmou logo na sequ�ncia que considera os problemas com intelig�ncia artificial "talvez mais urgentes do que os da mudan�a clim�tica".

"Eu e Hinton temos vis�es diferentes sobre alguns aspectos da intelig�ncia artificial. Eu me correspondi com ele h� pouco, eu expliquei a minha posi��o e ele concordou comigo, o que nem sempre acontece. Mas a quest�o principal em que concordamos � controle", afirma.

"N�o necessariamente concordo que [IA] seja uma amea�a maior do que a mudan�a clim�tica, mas � dif�cil saber. H� muitos dados estabelecidos para tentar estimar os riscos das mudan�as clim�ticas. Mas com a intelig�ncia artificial n�s nem sabemos como calcular esses riscos".

"Mas, para mim, a chance de que essas ferramentas sejam usadas para abalar democracias � essencialmente de 100%. Agora, se h� chance de os rob�s dominarem o planeta, n�o temos ideia. � razo�vel que algumas pessoas se dediquem a esse cen�rio. Estamos construindo ferramentas muito poderosas. Devemos considerar essas amea�as".

/imgsapp.em.com.br/app/autor/2021/05/07/fotos/20210507125942860406i.jpg)

*Para comentar, fa�a seu login ou assine