O Centro de Seguran�a de Intelig�ncia Artificial sugere uma s�rie de poss�veis cen�rios de desastre por mau uso dessa tecnologia

A intelig�ncia artificial (IA) pode levar a humanidade � extin��o, alertaram especialistas — incluindo os chefes da OpenAI e do Google Deepmind. Dezenas apoiaram uma declara��o publicada na p�gina do Center for AI Safety (ou Centro de Seguran�a de Intelig�ncia Artificial, em tradu��o livre), ong de pesquisa e desenvolvimento com sede em S�o Francisco, nos Estados Unidos.

Mas outros dizem que os medos s�o exagerados. Sam Altman, executivo-chefe da OpenAI, fabricante do ChatGPT, Demis Hassabis, executivo-chefe do Google DeepMind e Dario Amodei, da Anthropic, apoiaram a declara��o.

O texto do Center for AI Safety sugere uma s�rie de poss�veis cen�rios de desastre:

- As IAs podem ser armadas — por exemplo, com ferramentas para descobrir drogas que podem ser usadas na constru��o de armas qu�micas;

- A desinforma��o gerada pela IA pode desestabilizar a sociedade e "minar as tomadas de decis�es coletivas";

- O poder da IA pode se tornar cada vez mais concentrado em poucas m�os, permitindo que "regimes imponham valores restritos por meio de vigil�ncia generalizada e censura opressiva";

- Enfraquecimento, a partir do qual os humanos se tornam dependentes da IA, "num cen�rio semelhante ao retratado no filme Wall-E".

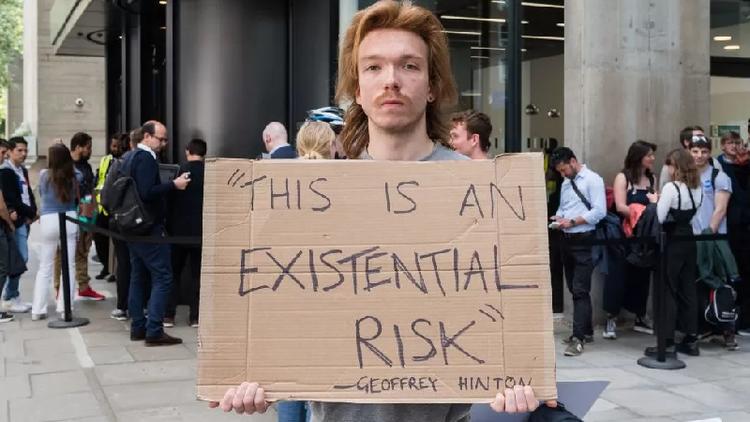

Geoffrey Hinton, que emitiu um alerta anterior sobre os riscos da IA superinteligente, tamb�m apoiou a carta do Center for AI Safety.

Yoshua Bengio, professor de Ci�ncias da Computa��o na Universidade de Montreal, no Canad�, tamb�m assinou o manifesto.

Hinton, Bengio e o professor da Universidade de Nova York (NYU), Yann LeCunn, s�o frequentemente descritos como os "padrinhos da IA" pelo trabalho inovador que fizeram neste campo — e pelo qual ganharam juntos o Pr�mio Turing de 2018, que reconhece contribui��es excepcionais na ci�ncia da computa��o.

Leia tamb�m: Tecnologia usada no filme Avatar vai revolucionar diagn�stico de doen�as.

Mas o professor LeCunn, que tamb�m trabalha na Meta, empresa dona do Facebook, disse que esses avisos apocal�pticos s�o "exagerados" e que "a rea��o mais comum dos pesquisadores de IA a essas profecias de destrui��o � embara�osa".

Muitos outros especialistas tamb�m acreditam que o medo de a IA acabar com a humanidade � irreal e uma distra��o de quest�es como preconceito em rela��o aos sistemas, que j� s�o um problema.

Arvind Narayanan, um cientista da computa��o da Universidade de Princeton, nos EUA, disse � BBC que os cen�rios de desastre de fic��o cient�fica n�o s�o realistas.

"A IA atual n�o � nem de longe suficientemente capaz para que esses riscos se materializem. Como resultado, isso desvia a aten��o dos danos de curto prazo da IA", avalia ele.

Elizabeth Renieris, pesquisadora s�nior do Instituto de �tica em IA da Universidade Oxford, no Reino Unido, disse � BBC News que se preocupa com os riscos mais pr�ximos.

Leia tamb�m: Intelig�ncia artificial desenvolve antibi�tico contra superbact�ria .

"Os avan�os na IA ampliar�o a escala da tomada de decis�o automatizada que � tendenciosa, discriminat�ria, excludente ou injusta. Ao mesmo tempo em que � inescrut�vel e incontest�vel", acredita ela.

Estes avan�os "podem impulsionar um aumento exponencial no volume e na dissemina��o de desinforma��o, fraturando assim a realidade e corroendo a confian�a do p�blico, al�m de gerar mais desigualdade, principalmente para aqueles que permanecem do lado errado da divis�o digital".

Muitas ferramentas de IA essencialmente "pegam carona" em "toda a experi�ncia humana at� o momento", destaca Renieris.

V�rias dessas tecnologias s�o treinadas em conte�do, texto, arte e m�sica criados por humanos — e seus criadores "transferiram efetivamente uma tremenda riqueza e poder da esfera p�blica para um pequeno punhado de entidades privadas".

Pausa solicitada

A cobertura da imprensa sobre a suposta amea�a "existencial" da IA aumentou desde mar�o de 2023, quando especialistas, incluindo o dono da Tesla, Elon Musk, assinaram uma carta aberta pedindo a suspens�o do desenvolvimento da pr�xima gera��o de tecnologia de IA.

Essa carta perguntava se dever�amos "desenvolver mentes n�o-humanas que eventualmente superassem em n�mero, fossem mais espertas, nos tornassem obsoletos e nos substitu�ssem". Em contraste, a nova carta divulgada por especialistas tem uma declara��o muito curta, destinada a "abrir a discuss�o".

A declara��o compara o risco ao representado pela guerra nuclear.

Em uma postagem no blog, a OpenAI sugeriu recentemente que a superintelig�ncia pode ser regulada de maneira semelhante � energia nuclear. "� prov�vel que eventualmente precisemos de algo como uma AIEA (Ag�ncia Internacional de Energia At�mica) para os esfor�os de superintelig�ncia", escreveu a empresa.

An�lises cuidadosas

Sam Altman e o executivo-chefe do Google, Sundar Pichai, est�o entre os l�deres de tecnologia que discutiram recentemente a regulamenta��o da IA com o primeiro-ministro ingl�s, Rishi Sunak.

Ao falar com rep�rteres sobre o �ltimo alerta sobre o risco de IA, Sunak enfatizou os benef�cios da tecnologia para a economia e a sociedade.

"Voc� viu que recentemente a IA ajudou pessoas paralisadas a andar e descobriu novos antibi�ticos, mas precisamos garantir que isso seja feito de maneira segura e protegida", disse ele.

Leia tamb�m: Intelig�ncia Artificial na sa�de: saiba quais os benef�cios e os cuidados.

"� por isso que me encontrei na semana passada com CEOs de grandes empresas de IA para discutir quais s�o as barreiras que precisamos implementar e qual � o tipo de regulamenta��o que deve ser criada para nos manter seguros."

"As pessoas ficar�o preocupadas com os relatos de que a IA representa riscos existenciais, como as pandemias ou as guerras nucleares. Mas quero que elas tenham certeza de que o governo est� analisando isso com muito cuidado", concluiu.

Sunak disse que havia discutido a quest�o recentemente com outros l�deres na c�pula do G7 no Jap�o e iria lev�-lo novamente a representantes dos EUA em breve. A c�pula de pa�ses mais ricos, inclusive, criou recentemente um grupo de trabalho sobre a IA.

- Este texto foi publicado em https://www.bbc.com/portuguese/articles/c51q3jvlyj8o

/imgs.em.com.br/bbc/bbcnews.jpg)

*Para comentar, fa�a seu login ou assine